Active Deterrence

Start projektu: grudzień 2025 — obecnie

Rola: AI / Computer Vision Engineer

Status: 🟢 Aktywny rozwój

Współpraca: SmartDrones, Karabela

Opis projektu

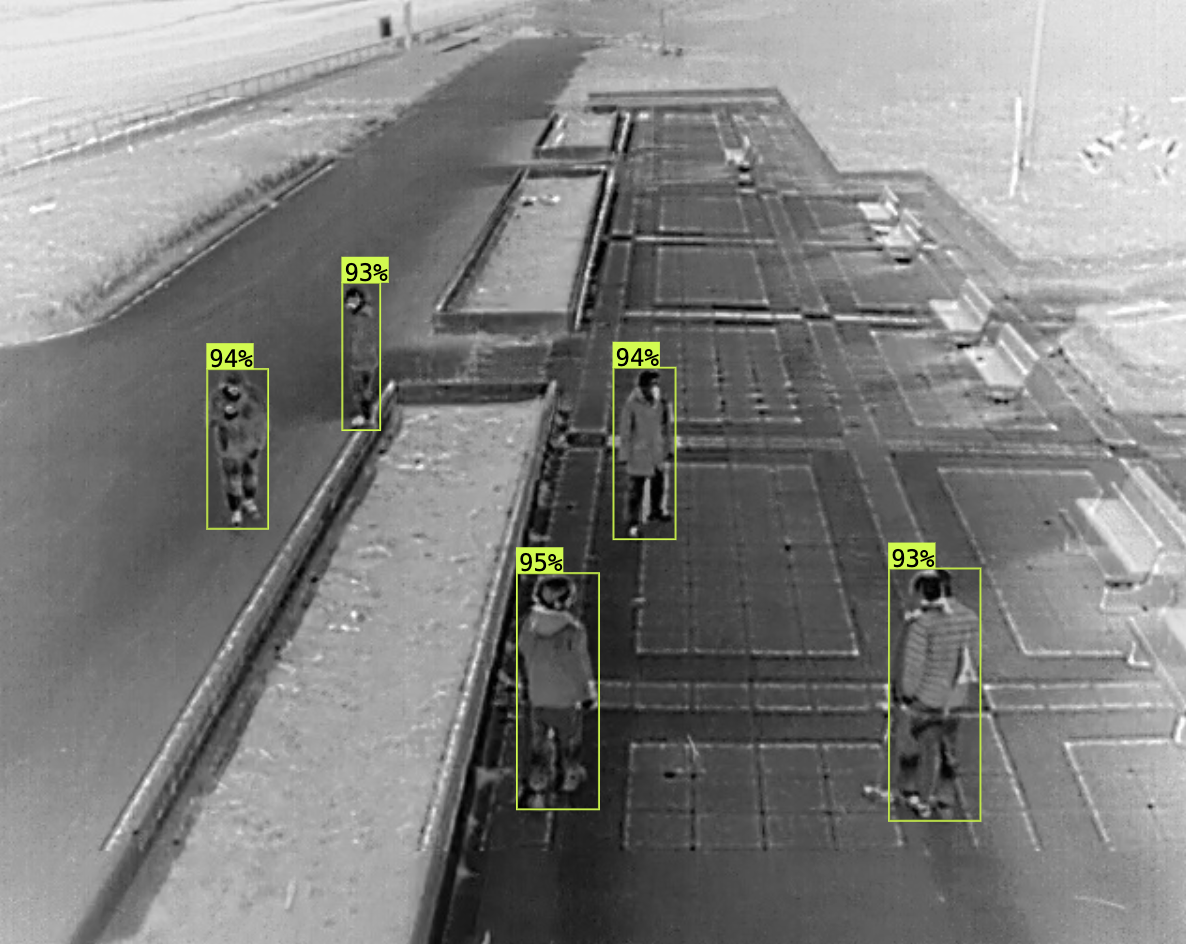

Active Deterrence to system AI Vision dla autonomicznych dronów security. Projekt adresuje kluczową lukę w obecnych rozwiązaniach bezpieczeństwa: istniejące systemy potrafią wykryć ruch, ale nie rozumieją tego, co widzą i nie mogą odpowiednio zareagować.

Obecne ograniczenia autonomicznych dronów security:

- detekcja bez zrozumienia — potrafią wykryć ruch, ale nie klasyfikują, co wywołało alert

- wysoki poziom fałszywych alarmów — alerty wywoływane przez zwierzęta, cienie, liście

- brak inteligentnej reakcji — operatorzy są zalewani powiadomieniami

- tylko pasywny monitoring — brak możliwości aktywnego odstraszania

Buduję kompletny pipeline AI, który przekształca surowy materiał wideo z drona w użyteczną inteligencję bezpieczeństwa — wykrywając i klasyfikując obiekty (osoby, pojazdy), filtrując fałszywe alarmy i umożliwiając automatyczne odstraszanie głosowe po wykryciu intruza.

Architektura

Active Deterrence to pipeline obraz → detekcja → decyzja → głos:

- Ingestion wideo — MP4/RTSP/JPG z dronów (tryby dzień + IR/noc)

- Warstwa Computer Vision — YOLOv8 dostrojony na nagraniach z dronów

- Logika alertów — próg pewności (40%+), alert cooldown, sampling klatek

- Voice AI (Active Deterrence) — ElevenLabs TTS do alertów głosowych w czasie rzeczywistym (~300-500ms latencji)

- Pipeline treningowy — GPU Droplet (H100/A100) na Digital Ocean z monitoringiem TensorBoard

Rozwój modelu

Kluczowym aspektem projektu był iteracyjny proces treningu modelu. Przeprowadziłem 4 iteracje treningu z różnymi kombinacjami datasetów:

| Model | Dataset | mAP@50 | Precision | Recall | Kluczowy wniosek |

|---|---|---|---|---|---|

| v2 | Tylko Karabela (218 img) | 82.4% | 86.7% | 85.4% | Baseline, zaobserwowany overfitting |

| v3 | Karabela + HIT-UAV (~3k img) | 93.5% | 93.2% | 90.3% | Najlepsza wydajność |

| v4 | + VisDrone (~10k img) | 62.0% | 79.1% | 57.4% | Degradacja przez domain mismatch |

Wnioski techniczne

Więcej danych ≠ lepszy model

Dodanie 10 000 zdjęć z VisDrone faktycznie pogorszyło wyniki. Analiza ujawniła nierównowagę klas (dominacja pojazdów), domain mismatch (różne wysokości/kąty) i problemy z małymi obiektami.

Analiza Confusion Matrix jest krytyczna

Model v4 wykazał 9000 false negatives dla klasy vehicle — obiekty, które model całkowicie pominął. To ukierunkowało strategię optymalizacji.

Detekcja małych obiektów jest trudna

Pojazdy z wysokopułapowego nagrania drona często pojawiają się jako obiekty <20px. Rozwiązania obejmują SAHI (Slicing Aided Hyper Inference), preprocessing przez kafelkowanie i większe architektury modeli.

Co zrobiłem

- Zaprojektowałem architekturę systemu AI Vision dla dronów security

- Zbudowałem pipeline danych do pobierania i audytu z Google Drive

- Wykonałem labeling w Roboflow (klasy person, vehicle)

- Wytrenowałem 4 iteracje modelu z różnymi datasetami

- Zintegrowałem zewnętrzne datasety (HIT-UAV, VisDrone)

- Przeanalizowałem confusion matrix i zidentyfikowałem problemy small objects

- Zintegrowałem ElevenLabs TTS do alertów głosowych

- Zbudowałem demo Streamlit z pełnym flow: upload → detekcja → alert

- Przygotowałem infrastrukturę treningu GPU (Digital Ocean + TensorBoard)

Umiejętności

| Kategoria | Technologie |

|---|---|

| Computer Vision | YOLOv8, PyTorch, OpenCV, Roboflow |

| Deep Learning | Transfer Learning, Hyperparameter Tuning |

| MLOps | TensorBoard, Digital Ocean GPU, Docker |

| Voice AI | ElevenLabs TTS |

| Backend | FastAPI, Python |

| Frontend | Streamlit |

| Dane | FFmpeg, narzędzia do adnotacji |

Rezultaty

- Model v3 z mAP 93.5% — najlepszy wynik

- Działające demo: upload → detekcja → alert głosowy

- Zidentyfikowany problem detekcji małych obiektów (klasa vehicle)

- Pipeline treningowy gotowy do skalowania

- System Voice AI z latencją ~300-500ms

- Infrastruktura treningu GPU na Digital Ocean

Roadmapa

MVP (Styczeń 2026) ✅

- Computer Vision — detekcja osób/pojazdów

- Model v2/v3/v4 (iteracyjny trening)

- Demo Streamlit z Voice AI

- Analiza confusion matrix

Następna faza: Optymalizacja hiperparametrów (Q1 2026)

- Trening na GPU Droplet z tuningiem hiperparametrów

- Workflow SAHI dla detekcji małych obiektów

- Strategie balansowania klas

Przyszłość: MLOps i produkcja (Q1-Q2 2026)

- MLflow Tracking & Model Registry

- Wdrożenie backendu FastAPI

- Inferencja RTSP w czasie rzeczywistym

- Integracja z platformą SmartDrones

Zdjęcia